大多数团队真正遇到“动作捕捉”这个需求,不是在做电影特效,而是在做内容生产:你找到一段转化很好的动作节奏(指向卖点的手势、试穿时的转身、讲解时的停顿与强调),但你没法把它稳定地复用到不同的人物、不同的服装、不同的 SKU 上。你写“跳舞”“自信走路”“热情讲解”也会得到运动,但那不是你想复刻的运动;偶尔跑中一次,后面 20 次又漂成不同的节奏、不同的摆臂、不同的构图。

这篇文章把“AI 动作捕捉”当成一个可复用的生产原子:把表演从身份里拆出来,把动作变成资产,把资产变成工作流。它不会教你 mocap 行业全套术语,而是回答更现实的问题:什么样的参考视频才“能迁移”,Pose-to-Video 的控制信号到底是什么,哪些失败形态可以提前规避,以及如何让它变成每周都能跑的稳定流程。适用范围:截至 2026-02,面向广告、UGC 风格短视频与虚拟人内容,而不是长片工业管线。

创意团队口中的“AI 动作捕捉”到底指什么

在创意与营销团队里,“AI 动作捕捉”大多指的是 markerless mocap(无标记点动作捕捉):你不搭棚、不贴点、不建 rig,而是用普通视频里的表演,提取出一个可用的动作信号(常见形式是姿态序列),再用这个信号去驱动生成,得到可发布的视频结果。它输出的不是骨骼文件,而是一段能剪、能投、能复用的素材。

这一定义重要在于:它把优化方向从“写更长的提示词”改成“让动作信号更可执行”。当你把动作当成一个可复用资产时,生产就会变得更像工程:失败了你能知道是动作源不干净,还是身份锚点不稳定,而不是靠祈祷多跑几次。

为什么 markerless mocap 能变成可控信号(它的核心是姿态估计)

无标记点动作捕捉之所以能落地,是因为现代姿态估计可以把每一帧压缩成一个“人体结构的近似”:头、肩、肘、髋、膝、踝等关键点的 2D 或 3D 位置。对生产来说,这一串关键点随时间变化的序列,就是你的控制层。它告诉模型“身体在每个时刻大概应该在哪儿”,而身份、服装、场景、风格则交给另一层输入去决定。

只记一句话就够:姿态是模型能执行的约束,形容词不是。一旦你把动作变成了可执行的约束,它就能被复用、被排错、被拆片段修补,这也是 Pose-to-Video 能规模化的根本原因。

一个能跑得动、也能跑得久的 Pose-to-Video 工作流逻辑

Pose-to-Video 的可复用性,来自“分工明确”。最稳的工作流会把职责拆成三块:身份输入负责“是谁”(角色、服装、产品展示主体),动作输入负责“怎么动”(节奏、摆臂、步态、停顿),文本只负责“偏置”(气质、镜头语言、细节强调),而不是用来发明动作本身。这样做的好处是可排错:你不喜欢动作就换动作源,你不喜欢人就换身份锚点,氛围不对再调文本。

在 OpenCreator 里,一个很实用的组合是:先用姿势创意把“动作语言”选出来,再用动作迁移把节奏固定住,最后用分镜把短片段组装成可剪辑的成片结构。它分别对应了真实生产的三件事:姿势库(身体在做什么)、动作资产(身体怎么动)、分镜结构(最终怎么剪)。

相关模板与工作流入口:

模特姿势创意模板(姿势库起点),以及 12 宫格分镜一键成片(把片段变成叙事结构)。

参考动作怎么选:避免“肢体融化”的几条硬规则

最烧 credits 的错误,是把“好看但不适合迁移”的视频当动作源:频繁跳切、强烈手持抖动、肢体经常出画、遮挡很多、或者极端透视和旋转。markerless mocap 并不会凭空知道你被遮住的手腕到底在哪儿;它看不清,就会脑补。脑补在生成里通常表现为抖动、错位、肢体交换、或身体结构像在融化。

真正好迁移的参考视频往往有点“无聊”:镜头稳、距离相对固定、身体大部分时间完整可见、动作轮廓清晰。如果你自己录,按产品演示的标准来拍:穿和背景有对比度的衣服,避免过于宽松遮住肘腕,少用遮住躯干的道具,尽量固定机位。你会发现参考视频越“干净”,后面的生成越像在做可控生产而不是抽卡。

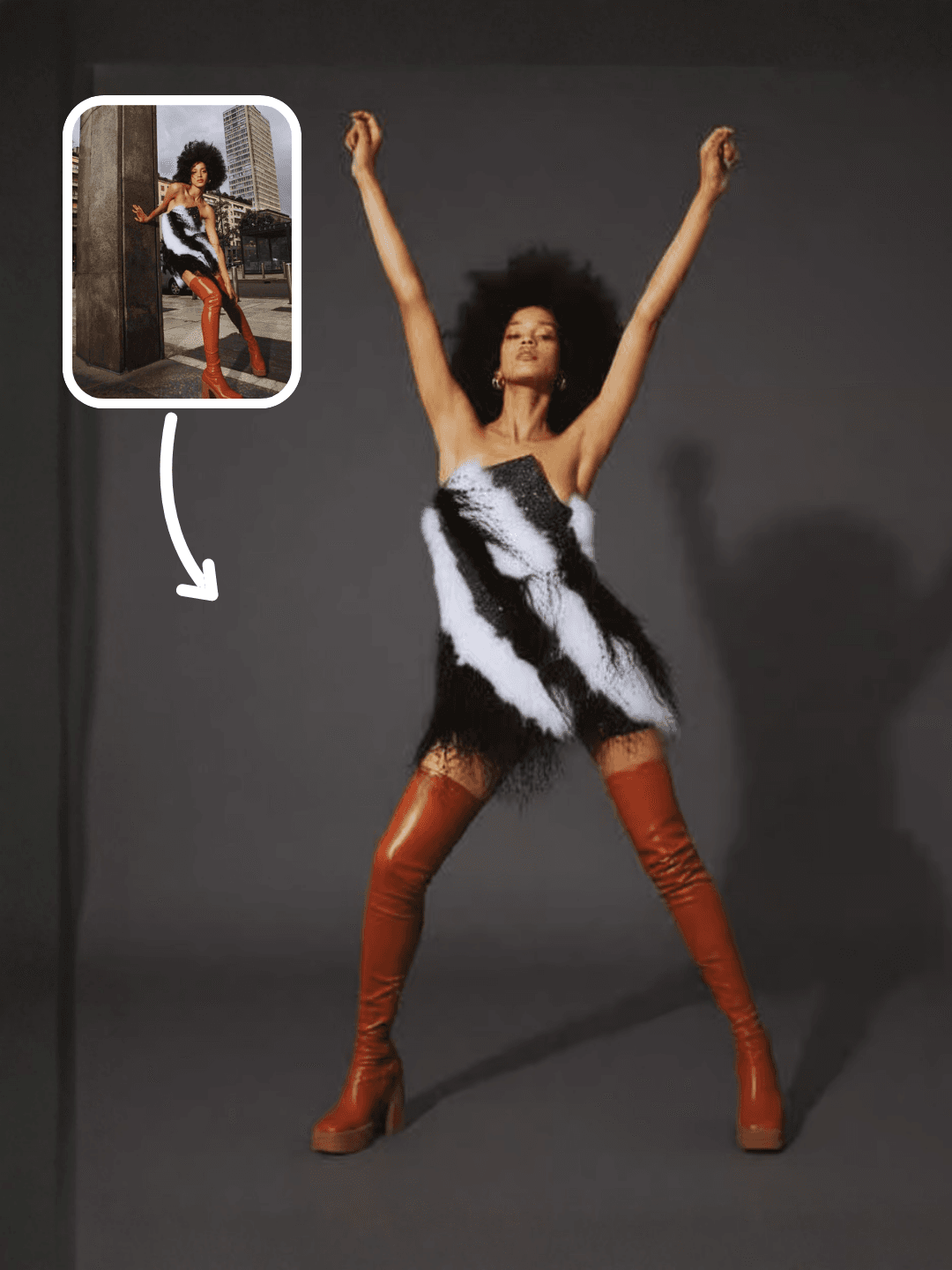

一个可复用的动作资产示例:把舞蹈 loop 变成“动作原子”

理解“动作资产”最直观的方法,是从一个短的舞蹈 loop 开始。你不是要发布宠物舞蹈,而是用它观察:当动作源足够清晰时,节奏与摆动是如何被稳定迁移的,以及它怎样变成可复用的生产积木。

当你找到一段“迁移成功率高”的动作 loop,它就会从一次性的 Demo 变成生产系统的一部分:你可以把主体换成虚拟人、把服装换成不同的款式、把场景换成不同的投放背景,但动作节奏仍然是同一个。对营销内容来说,这种节奏一致性很像“品牌动作语言”:它让观众记住的是一种稳定的表现模式,而不是每条都随机抽到的动作。

如果你现在最关心的是“用参考视频把动作迁移到新主体上”,Kling 的 Motion Control 原子就是为这个意图设计的。这篇文章更偏输入与失败形态的细节: Kling Motion Control(动作迁移)原子指南。

Pose-to-Video 最常见的崩法(以及不用重写所有东西的修复思路)

Pose-to-Video 的崩法大多可预测。第一类是可见性:手腕和脚踝小、快、又容易遮挡,是最先漂的关键点;第二类是自接触:交叉手臂、手摸脸、腿交叉会让关键点跟踪出现拓扑歧义,生成就开始抖;第三类是透视:快速转身、朝镜头逼近会让 2D 姿态对应到多种 3D 解释,模型可能每几秒就“换一个身体”。

修复通常是编辑策略,不是文学技巧。把片段切成 3-6 秒再拼接,换一个肢体更分离的参考动作,保持主体居中,减少镜头运动,优先选择轮廓可读的动作(指向、挥手、走路、简单转身)建立第一批动作库。需要更戏剧化的运动时,往往用分镜拆成多镜头更稳,而不是强迫一个长镜头承担所有约束。

动作捕捉、动作迁移与运镜控制:每层该干什么

动作捕捉最强的是节奏与身体时序;动作迁移最强的是“复用一段表演并替换身份”;运镜控制最强的是相机运动本身(推、拉、环绕、摇、俯仰)。很多“不稳定”,其实来自让同一条生成同时承担复杂动作和复杂运镜。你越想在 8 秒里同时要“跳得复杂 + 镜头环绕 + 主体不变形”,成功率越像抽卡。

如果你的核心是镜头运动,把运镜当成独立控制层会更稳: AI 镜头运动控制(推拉摇移与 orbit),并配合分镜把复杂意图拆镜头: 同场景多机位 / 多镜头分镜工作流。把职责拆开,你就能在剪辑里组合,而不是让模型在一次采样里同时解所有约束。

证据备注(给需要“信源与边界”的团队)

markerless mocap 并不是营销话术,它建立在姿态估计与人体姿态重建的研究与工程基础上。常被引用的基础工作包括 OpenPose(Cao 等,CVPR 2017)这样的 2D 姿态估计体系,MoveNet(Google / TensorFlow)与 MediaPipe Pose 这类轻量实时关键点跟踪方案,VideoPose3D(Pavllo 等,2019)这类从视频估计 3D 姿态的方法,以及 OpenCap(2023 年发表研究)这种“用普通相机做无标记点动作捕捉”的代表性系统。

你不需要自己实现这些算法,但理解它们的边界(遮挡、快速运动、透视歧义)会解释你在 Pose-to-Video 里看到的大多数失败形态,也会让你的修复策略更像工程而不是玄学。

FAQ

Pose-to-Video 和动作捕捉是一回事吗?

在创意生产里,它通常就是动作捕捉的“可用版本”:用视频提姿态信号,再用信号驱动生成,得到可发布素材。传统棚拍 mocap 仍然是另一条工业管线(标记点、绑定、重定向)。

一定要棚拍、打光、绿幕才能稳定吗?

不一定,但你需要“干净的参考”。镜头稳定、距离一致、肢体可见比背景好不好看更重要。很多时候,“普通但清晰”的参考比“电影感但复杂”的参考更能迁移。

为什么手最容易崩?

手小、快、遮挡多,而且经常自接触。参考视频里手腕/手指连续几帧不可见,模型就会脑补过渡,生成里就表现为抖动或形变。做动作库的第一阶段,尽量简化手势并保持可见。

怎么把它变成每周都能跑的生产系统?

把参考动作当资产管理。先做 5-20 条“迁移成功率高”的动作 loop,再在每次投放里替换身份输入和场景偏置。工作流的价值是把一次成功变成可重复的 SOP,而不是每条都从零抽卡。